- Japón ha arrestado a cuatro individuos por vender imágenes obscenas generadas por IA, marcando la primera acción legal del país contra tales actividades.

- Las imágenes, que presentan mujeres inexistentes, fueron creadas con IA generativa y vendidas en línea como carteles.

- Este caso destaca las preocupaciones globales sobre el uso indebido de la IA, particularmente en relación con el contenido deepfake, donde el 96% de los videos son ilícitos, a menudo dirigidos a mujeres.

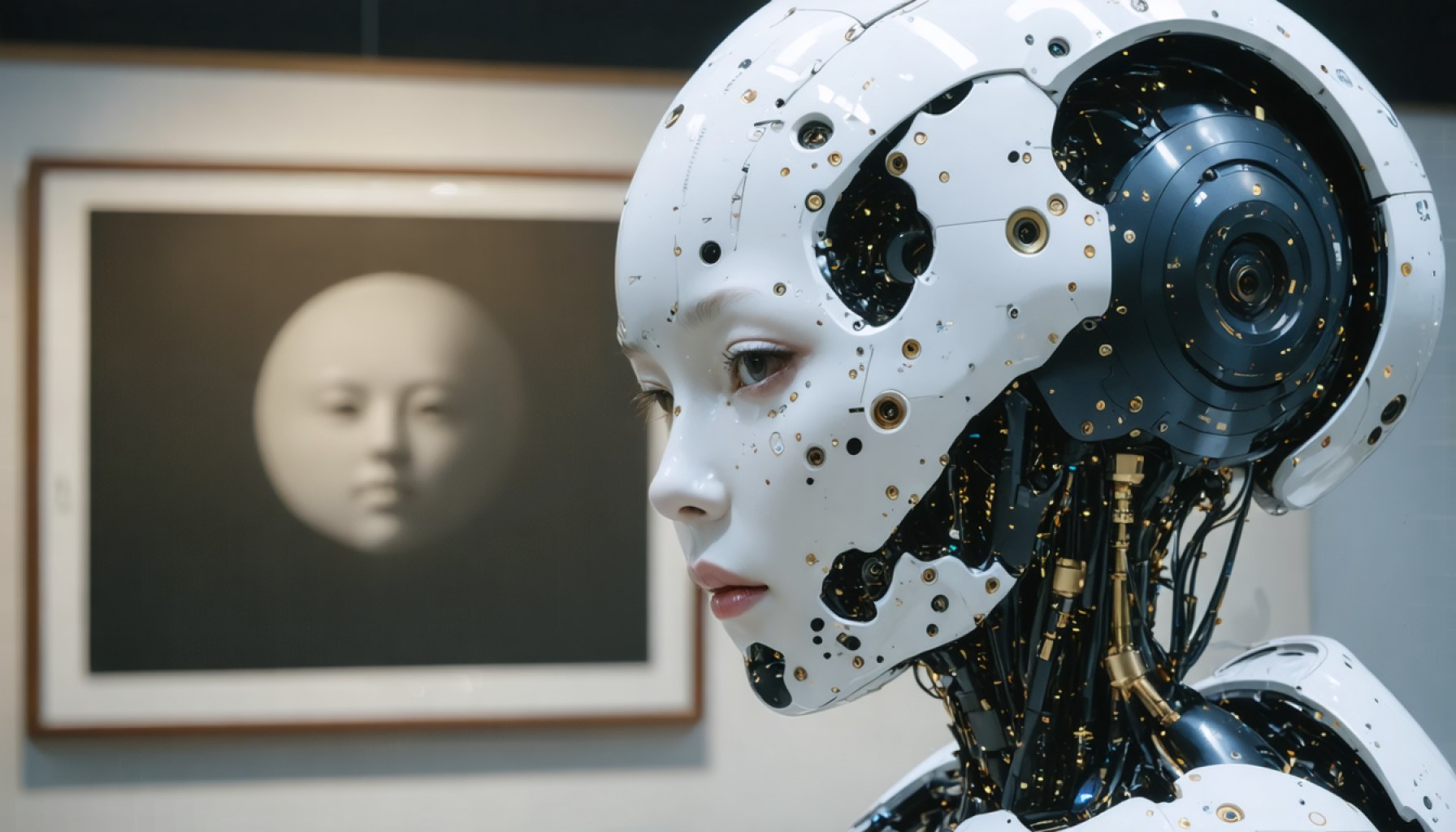

- La IA generativa puede producir contenido hiperrealista a partir de simples indicaciones, lo que plantea dilemas éticos.

- Los arrestos enfatizan la necesidad de un diálogo global y medidas regulatorias para garantizar el uso ético de la IA mientras se protegen los derechos personales.

- Las acciones de Japón podrían potencialmente sentar precedentes internacionales mientras el mundo busca formas de equilibrar la innovación de la IA con consideraciones éticas.

En un desarrollo notable, las autoridades japonesas han tomado acciones decisivas que destacan un desalentador cruce entre el avance tecnológico y la moralidad. Cuatro individuos, de diversas edades que van desde sus 20 hasta 50 años, enfrentan graves acusaciones por vender imágenes obscenas elaboradas a través de IA generativa, marcando la primera represión legal de Japón en esta esfera controvertida.

Estos individuos supuestamente aprovecharon software de IA disponible de forma gratuita para fabricar imágenes que representan a mujeres inexistentes en escenarios comprometedores e indecentes. Estas imágenes digitalmente conjuradas fueron luego comercializadas como carteles en plataformas de subastas por internet, alcanzando precios en el rango de varios miles de yenes cada una. Este intrigante pero perturbador drama se desarrolla en medio de crecientes ansiedades globales sobre el potencial uso indebido de la IA.

En el complejo ámbito de la inteligencia artificial, los algoritmos generativos poseen la asombrosa capacidad de producir imágenes y videos hiperrealistas a partir de simples indicaciones de texto. Por revolucionario que suene, tal capacidad genera desafíos igualmente significativos. Una revelación preocupante del organismo de vigilancia de IA de los Países Bajos, Sensity, indica que un asombroso 96 por ciento de los videos deepfake que circulan en línea constituyen pornografía ilícita, teniendo a las mujeres predominantemente como víctimas.

Los recientes arrestos en Japón subrayan la urgente necesidad de un discurso global y regulación sobre los límites éticos de la tecnología de IA. A medida que la IA se integra más en la vida cotidiana, aprovechar su promesa sin caer en los abismos de la explotación plantea un formidable desafío. Se necesitan conversaciones sobre la protección de los derechos personales y el establecimiento de pautas éticas que resuenen a nivel mundial, con el objetivo de evitar que la IA se transforme en un instrumento de daño.

La conclusión crítica de estos sorprendentes eventos es un llamado claro a la búsqueda de equilibrio: una búsqueda para aprovechar las notables capacidades de la IA de manera responsable mientras se protege vigilantemente contra su potencial de uso indebido. A medida que las posibilidades de la tecnología se expanden, también deben hacerlo los marcos que la rigen, asegurando que la innovación no supere las consideraciones públicas y éticas. El mundo observa cómo Japón navega por este territorio sin precedentes, estableciendo precedentes potenciales para que otros los sigan.

Dentro de la Represión de IA en Japón: La Batalla Entre Innovación y Ética

Desglosando la Acción Pionera de Japón Contra el Contenido Generado por IA

La reciente represión legal en Japón contra la venta de imágenes obscenas generadas por IA marca un momento significativo en el debate en curso sobre el uso ético de la inteligencia artificial. Estos arrestos destacan un conflicto creciente entre el rápido desarrollo de las tecnologías de IA y las consideraciones éticas que las acompañan. Aquí, profundizamos en este complejo problema, proporcionando contexto, posibles implicaciones y perspectivas sobre el impacto más amplio de la IA en la sociedad.

Cómo la IA Cambia el Panorama de la Creación de Contenido

1. Algoritmos Generativos: La tecnología detrás de estas imágenes generadas por IA se basa en algoritmos sofisticados capaces de crear imágenes y videos hiperrealistas a partir de indicaciones de texto. Esta innovación, aunque revolucionaria, plantea serias preguntas morales y éticas cuando se utiliza indebidamente.

2. La Espada de Doble Filo de la IA: La capacidad de la IA para crear contenido realista plantea un problema único: si bien puede revolucionar sectores como el entretenimiento y la publicidad, también corre el riesgo de consecuencias graves, como la creación de pornografía deepfake, desinformación o suplantaciones de identidad no autorizadas.

Contexto Global y Preocupaciones

– Prevalencia de Deepfakes: Un estudio de Sensity informa que el 96% de los videos deepfake son pornografía no consensuada, dirigido principalmente a mujeres. Esta estadística subraya la urgente necesidad de directrices internacionales completas para abordar este uso indebido.

– Regulaciones Actuales: Aunque algunos países han iniciado discusiones sobre regulaciones, existe una falta de política global cohesiva o infraestructura para vigilar y prevenir el uso indebido de la IA. Esta discrepancia deja espacio para la explotación y subraya la necesidad de un enfoque unificado para la gobernanza de la IA.

Casos de Uso en el Mundo Real y Riesgos

– Aplicaciones Positivas: El potencial de la IA incluye mejorar diagnósticos médicos, crear contenido educativo atractivo y desarrollar experiencias personalizadas para los clientes. Sin embargo, sin la supervisión adecuada, el riesgo de uso indebido es considerable.

– Pronóstico del Mercado: Se espera que el mercado de inteligencia artificial crezca exponencialmente, enfatizando la necesidad inmediata de marcos éticos que guíen su implementación en diversas industrias.

Pasos Hacia un Uso Responsable de la IA

1. Establecer Regulaciones Claras: Los gobiernos y entidades globales deben colaborar para crear marcos regulatorios robustos que prevengan el uso indebido de la IA mientras fomentan el avance tecnológico.

2. Conciencia Pública y Educación: Se debe fomentar una mayor conciencia sobre las consecuencias del uso indebido de la IA a través de campañas de educación pública, asegurando que las personas comprendan tanto los beneficios potenciales de la IA como sus trampas.

3. Promover el Desarrollo Ético de la IA: Fomentar la investigación y el desarrollo de IA centrados en resultados éticos, incorporando diversas perspectivas para crear algoritmos equilibrados que prioricen los derechos humanos y la privacidad.

4. Fomentar la Transparencia: Las organizaciones deben desarrollar sistemas de IA transparentes y proporcionar información clara sobre cómo se genera y utiliza el contenido de IA.

Resumen de Pros y Contras

– Pros: Los avances en IA traen innovación, eficiencia y capacidades mejoradas en diversas industrias, desde la atención médica hasta la producción cinematográfica.

– Contras: El potencial de uso indebido de la IA presenta riesgos para la privacidad, la seguridad y los estándares éticos, lo que requiere atención urgente y medidas proactivas.

Recomendaciones Finales para la Acción Inmediata

– Vigilancia del Consumidor: Los individuos deben mantenerse alerta sobre el contenido generado por IA que consumen, cuestionando la fuente y la autenticidad.

– Abogacía por Regulaciones: Participar en discusiones políticas locales y globales para abogar por políticas de uso responsable de la IA.

– Prácticas Éticas de IA: Las empresas que utilizan IA deben adherirse a pautas éticas, asegurando que sus sistemas no contribuyan a daño o uso indebido.

Los eventos que se desarrollan en Japón pueden sentar un nuevo precedente sobre cómo las naciones de todo el mundo abordarán el intrincado desafío de la gobernanza de la IA, entrelazando la destreza tecnológica con la integridad ética. Para continuar innovando sin comprometer la ética, visite recursos autorizados como nombre del enlace para más información.