- Il Giappone ha arrestato quattro individui per aver venduto immagini oscene generate dall’IA, segnando la prima azione legale del paese contro tali attività.

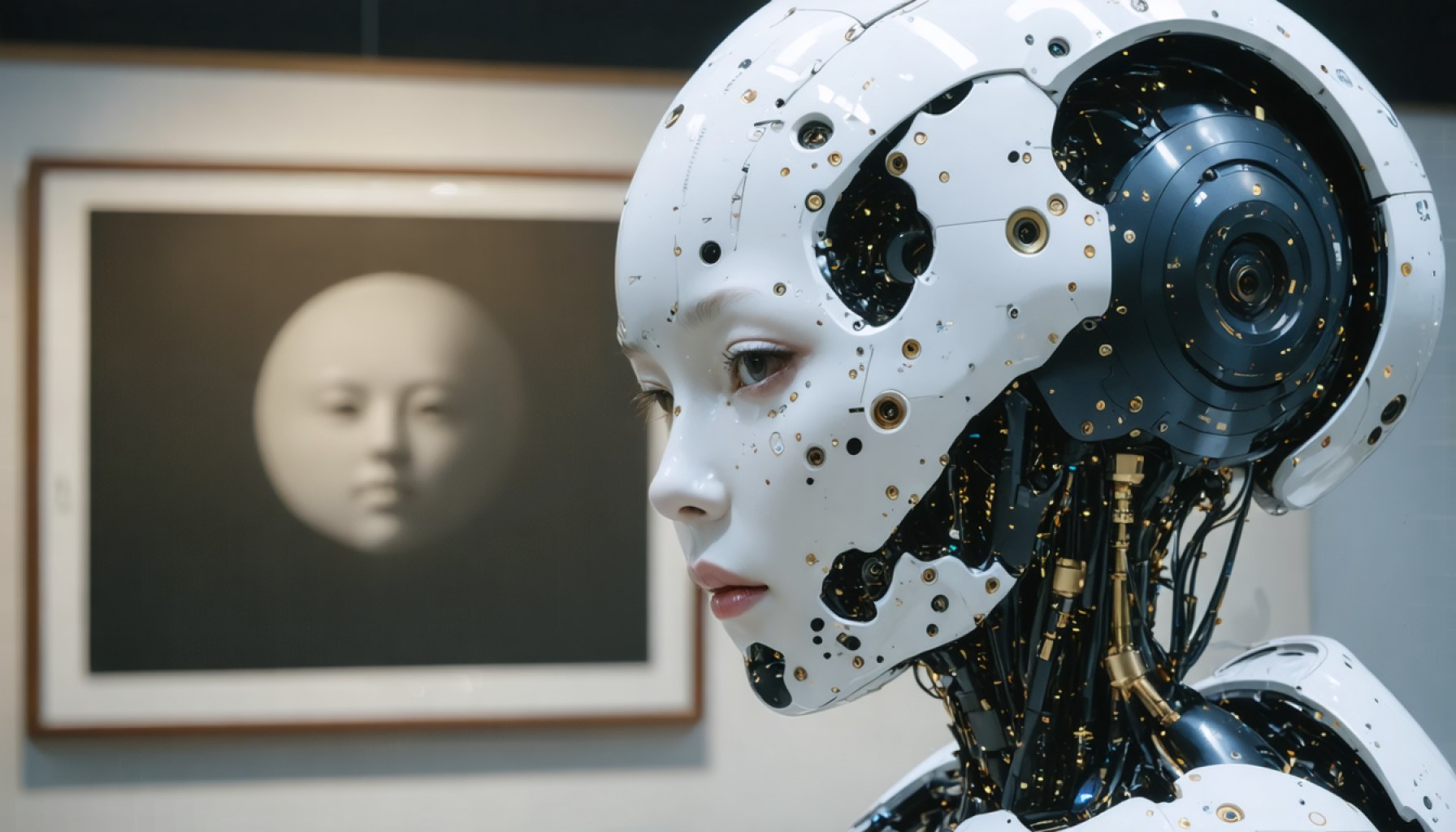

- Le immagini, che ritraggono donne inesistenti, sono state create con IA generativa e vendute online come poster.

- Questo caso evidenzia le preoccupazioni globali sull’abuso dell’IA, in particolare riguardo ai contenuti deepfake, dove il 96% dei video è illecito, spesso prendendo di mira le donne.

- L’IA generativa può produrre contenuti iper-realistici a partire da semplici suggerimenti, sollevando dilemmi etici.

- Gli arresti sottolineano la necessità di un dialogo globale e di misure normative per garantire un uso etico dell’IA, proteggendo al contempo i diritti personali.

- Le azioni del Giappone potrebbero potenzialmente stabilire precedenti internazionali mentre il mondo cerca modi per bilanciare l’innovazione dell’IA con considerazioni etiche.

In un sviluppo notevole, le autorità giapponesi hanno intrapreso azioni decisive che evidenziano un incrocio inquietante tra il progresso tecnologico e la moralità. Quattro individui, di età compresa tra i 20 e i 50 anni, affrontano ora gravi accuse di aver venduto immagini oscene create attraverso l’IA generativa, segnando il primo intervento legale del Giappone in questo ambito controverso.

Questi individui avrebbero sfruttato software di IA liberamente disponibili per produrre immagini che ritraggono donne inesistenti in scenari compromettenti e indecenti. Queste immagini digitalmente evocate sono state poi vendute come poster su piattaforme di aste online, con prezzi che si aggirano su diverse migliaia di yen ciascuna. Questo dramma intrigante ma inquietante si svolge in un contesto di crescenti ansie globali riguardo al potenziale abuso dell’IA.

Nel complesso regno dell’intelligenza artificiale, gli algoritmi generativi possiedono l’incredibile capacità di produrre immagini e video iper-realistici a partire da semplici suggerimenti testuali. Per quanto rivoluzionario possa sembrare, tale capacità genera sfide altrettanto significative. Una rivelazione preoccupante da parte del watchdog olandese dell’IA, Sensity, indica che un impressionante 96% dei video deepfake circolanti online costituisce pornografia illecita, con le donne prevalentemente come vittime.

Gli arresti recenti in Giappone sottolineano un urgente bisogno di discussione e regolamentazione globale riguardo ai confini etici della tecnologia IA. Man mano che l’IA si integra ulteriormente nella vita quotidiana, sfruttare la sua promessa senza cadere nei fossati dello sfruttamento rappresenta una sfida formidabile. Sono necessarie conversazioni attorno alla salvaguardia dei diritti personali e all’istituzione di linee guida etiche che risuonino a livello globale, mirando a prevenire la trasformazione dell’IA in uno strumento di danno.

Il punto critico di questi eventi sorprendenti è un appello chiaro per un equilibrio: una ricerca per sfruttare le straordinarie capacità dell’IA in modo responsabile, mentre si vigila attentamente contro il suo potenziale per l’abuso. Man mano che le possibilità della tecnologia si espandono, così devono fare anche i quadri che la governano, assicurando che l’innovazione non superi le considerazioni pubbliche ed etiche. Il mondo osserva mentre il Giappone naviga in questo territorio senza precedenti, stabilendo potenziali precedenti per altri da seguire.

Dentro la repressione dell’IA in Giappone: La battaglia tra innovazione ed etica

Analizzando l’azione pionieristica del Giappone contro i contenuti generati dall’IA

La recente repressione legale in Giappone contro la vendita di immagini oscene generate dall’IA segna un momento significativo nel dibattito in corso sull’uso etico dell’intelligenza artificiale. Questi arresti evidenziano un conflitto crescente tra lo sviluppo rapido delle tecnologie IA e le considerazioni etiche che li accompagnano. Qui, approfondiamo ulteriormente questa questione complessa, fornendo contesto, potenziali implicazioni e intuizioni sull’impatto più ampio dell’IA sulla società.

Come l’IA cambia il panorama della creazione di contenuti

1. Algoritmi generativi: La tecnologia dietro queste immagini generate dall’IA si basa su algoritmi sofisticati in grado di creare immagini e video iper-realistici a partire da suggerimenti testuali. Questa innovazione, pur essendo rivoluzionaria, solleva serie domande morali ed etiche quando viene abusata.

2. La doppia lama dell’IA: La capacità dell’IA di creare contenuti realistici pone un problema unico: mentre può rivoluzionare settori come l’intrattenimento e la pubblicità, rischia anche conseguenze serie, come la creazione di pornografia deepfake, disinformazione o impersonificazioni non autorizzate.

Contesto globale e preoccupazioni

– Prevalenza dei deepfake: Uno studio di Sensity riporta che il 96% dei video deepfake è pornografia non consensuale, principalmente rivolta alle donne. Questa statistica sottolinea l’urgenza di linee guida internazionali complete per affrontare questo abuso.

– Regolamenti attuali: Sebbene alcuni paesi abbiano avviato discussioni sui regolamenti, manca una politica o infrastruttura globale coesa per controllare e prevenire l’abuso dell’IA. Questa discrepanza lascia spazio per sfruttamenti e sottolinea la necessità di un approccio unificato alla governance dell’IA.

Casi d’uso nel mondo reale e rischi

– Applicazioni positive: Il potenziale dell’IA include il miglioramento delle diagnosi mediche, la creazione di contenuti educativi coinvolgenti e lo sviluppo di esperienze personalizzate per i clienti. Tuttavia, senza una supervisione adeguata, il rischio di abuso è elevato.

– Previsione di mercato: Si prevede che il mercato dell’intelligenza artificiale cresca esponenzialmente, sottolineando la necessità immediata di quadri etici per guidarne l’implementazione in vari settori.

Passi verso un uso responsabile dell’IA

1. Stabilire regolamenti chiari: I governi e le entità globali devono collaborare per creare quadri normativi robusti che prevengano l’abuso dell’IA, promuovendo al contempo il progresso tecnologico.

2. Consapevolezza pubblica e educazione: È necessario promuovere una maggiore consapevolezza riguardo alle conseguenze dell’abuso dell’IA attraverso campagne di educazione pubblica, assicurando che le persone comprendano sia i potenziali benefici dell’IA che i suoi rischi.

3. Promuovere lo sviluppo etico dell’IA: Incoraggiare la ricerca e lo sviluppo dell’IA incentrati su risultati etici, incorporando prospettive diverse per creare algoritmi bilanciati che diano priorità ai diritti umani e alla privacy.

4. Incoraggiare la trasparenza: Le organizzazioni dovrebbero sviluppare sistemi di IA trasparenti e fornire informazioni chiare su come vengono generati e utilizzati i contenuti dell’IA.

Panoramica dei pro e contro

– Pro: I progressi dell’IA portano innovazione, efficienza e capacità migliorate in vari settori, dalla sanità al cinema.

– Contro: Il potenziale di abuso dell’IA presenta rischi per la privacy, la sicurezza e gli standard etici, richiedendo un’attenzione urgente e misure proattive.

Raccomandazioni finali per azioni immediate

– Vigilanza dei consumatori: Gli individui dovrebbero rimanere vigili riguardo ai contenuti generati dall’IA che consumano, mettendo in discussione la fonte e l’autenticità.

– Advocacy per la regolamentazione: Partecipare a discussioni politiche locali e globali per promuovere politiche di utilizzo responsabile dell’IA.

– Pratiche etiche dell’IA: Le aziende che utilizzano l’IA dovrebbero attenersi a linee guida etiche, assicurandosi che i loro sistemi non contribuiscano a danni o abusi.

Gli eventi che si stanno svolgendo in Giappone potrebbero stabilire un nuovo precedente per come le nazioni di tutto il mondo affronteranno la complessa sfida della governance dell’IA, intrecciando la competenza tecnologica con l’integrità etica. Per un’innovazione continua senza compromessi etici, visita risorse autorevoli come nome del link per ulteriori approfondimenti.