- 日本は、AI生成のわいせつ画像を販売した4人を逮捕し、こうした活動に対する初の法的措置を講じました。

- 存在しない女性をフィーチャーした画像は、生成AIを用いて作成され、オンラインでポスターとして販売されました。

- この事件は、特に女性をターゲットにした96%の違法なディープフェイクコンテンツに関するAIの悪用に対する世界的な懸念を浮き彫りにしています。

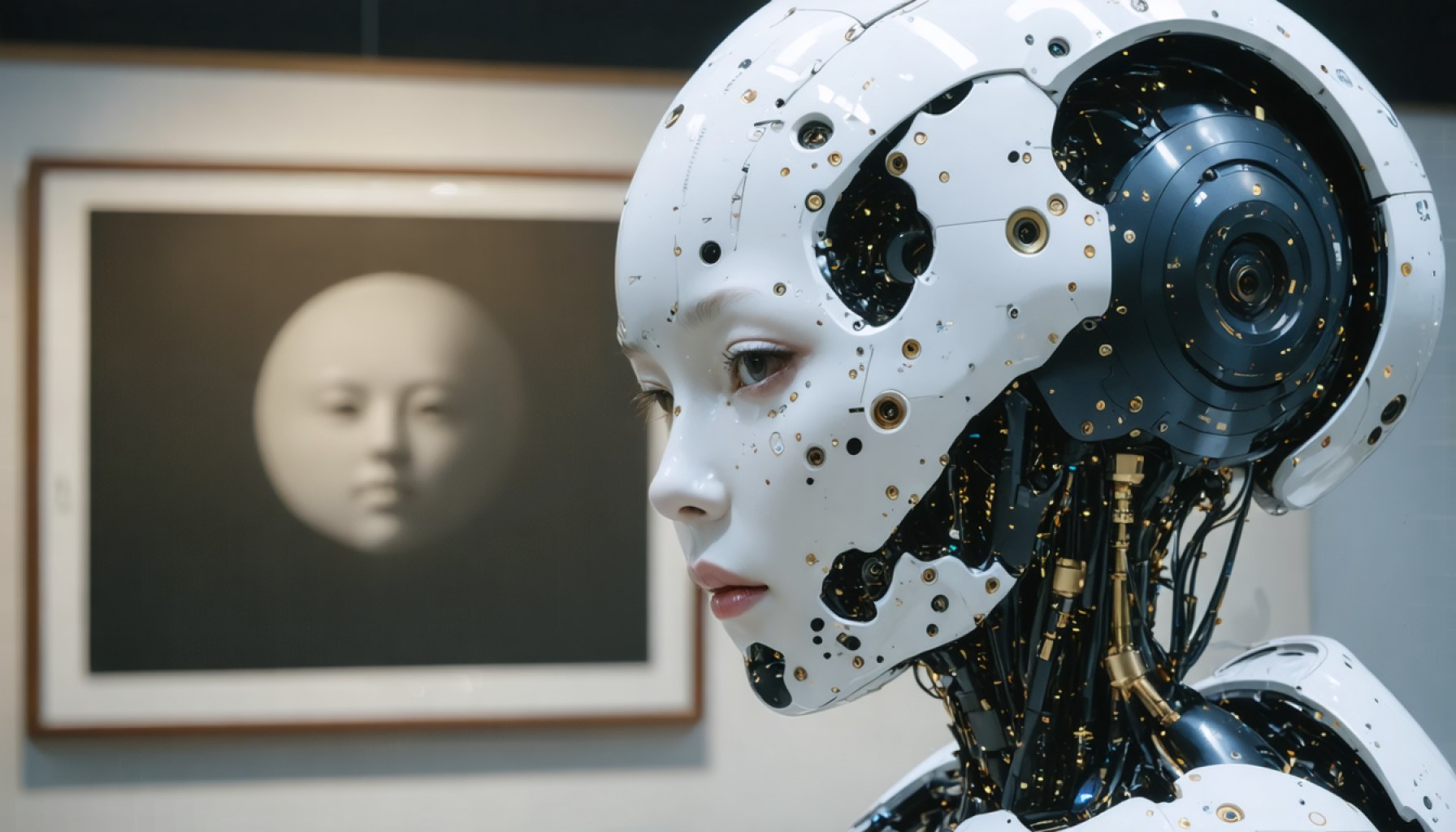

- 生成AIは、シンプルなプロンプトからハイパーリアリスティックなコンテンツを生成でき、倫理的なジレンマを引き起こします。

- 逮捕は、個人の権利を守りながら倫理的なAIの使用を確保するための世界的な対話と規制措置の必要性を強調しています。

- 日本の行動は、世界がAIの革新と倫理的配慮のバランスを取る方法を模索する中で、国際的な前例を設定する可能性があります。

注目すべき展開として、日本の当局は、技術の進歩と道徳の間の厳しい岐路を強調する決定的な行動を取っています。20代から50代までのさまざまな年齢層の4人が、生成AIによって作成されたわいせつ画像を販売したという重大な告発に直面しています—これは日本におけるこの物議を醸す分野での初の法的取り締まりを意味します。

これらの個人は、存在しない女性を不適切で下品なシナリオで描写した画像を製造するために、自由に利用できるAIソフトウェアを活用したと報じられています。これらのデジタルで創造された画像は、インターネットオークションプラットフォームでポスターとして販売され、数千円の価格で取引されました。この興味深くも不穏なドラマは、AIの潜在的な悪用に対する世界的な懸念が高まる中で展開されています。

人工知能の複雑な領域では、生成アルゴリズムがシンプルなテキストプロンプトからハイパーリアリスティックな画像や動画を生成する驚異的な能力を持っています。この能力は革命的ですが、同時に重大な課題も引き起こします。オランダのAI監視機関であるSensityによる懸念すべき発表によれば、オンラインで流通しているディープフェイク動画の驚くべき96%が違法なポルノであり、主に女性が犠牲となっています。

日本での最近の逮捕は、AI技術の倫理的限界に関する世界的な議論と規制の緊急性を強調しています。AIが日常生活にますます統合される中で、その約束を活用しつつ、搾取の深淵に陥らないようにすることは、困難な課題です。個人の権利を守ることや、AIが害を及ぼす道具に変わるのを防ぐための倫理的ガイドラインを確立することについての議論が必要です。

これらの驚くべき出来事からの重要な教訓は、バランスを求める警鐘です—AIの素晴らしい能力を責任を持って活用し、その悪用の可能性に対して警戒することを目指す探求です。技術の可能性が広がるにつれて、それを規制する枠組みも拡大し、革新が公共の倫理的配慮を超えないようにする必要があります。日本がこの前例のない領域を航行する様子を世界が見守り、他国が追随するための潜在的な前例を設定しています。

日本のAI取り締まりの内幕:革新と倫理の戦い

AI生成コンテンツに対する日本の先駆的行動を解明する

日本におけるAI生成のわいせつ画像販売に対する最近の法的取り締まりは、人工知能の倫理的使用に関する継続的な議論において重要な瞬間を示しています。これらの逮捕は、AI技術の急速な発展とそれに伴う倫理的考慮との間の増大する対立を浮き彫りにしています。ここでは、この複雑な問題を掘り下げ、文脈、潜在的な影響、およびAIが社会に与える広範な影響についての洞察を提供します。

AIがコンテンツ制作の風景をどのように変えるか

1. 生成アルゴリズム: これらのAI生成画像の背後にある技術は、テキストプロンプトからハイパーリアリスティックな画像や動画を作成する能力を持つ高度なアルゴリズムに基づいています。この革新は画期的ですが、悪用されると深刻な道徳的および倫理的な問題を招きます。

2. AIの二面性: AIがリアルなコンテンツを作成する能力は独特の問題を引き起こします—エンターテインメントや広告などの分野を革命化する一方で、ディープフェイクポルノや誤情報、無断の人物の偽装など、深刻な結果をもたらすリスクも伴います。

グローバルな文脈と懸念

– ディープフェイクの蔓延: Sensityによる研究では、ディープフェイク動画の96%が非同意のポルノであり、主に女性をターゲットにしていると報告されています。この統計は、この悪用に対処するための包括的な国際ガイドラインの緊急性を強調しています。

– 現在の規制: 一部の国では規制に関する議論が始まっていますが、AIの悪用を監視し防止するための統一されたグローバルポリシーやインフラが欠けています。この不一致は搾取の余地を残し、AIガバナンスに対する統一的なアプローチの必要性を浮き彫りにしています。

実世界の使用例とリスク

– ポジティブな応用: AIの潜在能力には、医療診断の向上、魅力的な教育コンテンツの作成、パーソナライズされた顧客体験の開発が含まれます。しかし、適切な監視がなければ、悪用のリスクが大きくなります。

– 市場予測: 人工知能市場は急激に成長すると予測されており、各業界での実施を導くための倫理的枠組みの即時の必要性が強調されています。

責任あるAI使用に向けたステップ

1. 明確な規制の確立: 政府と国際的な機関は、AIの悪用を防ぎながら技術の進歩を促進するための強固な規制枠組みを作成するために協力する必要があります。

2. 公共の意識と教育: AIの悪用の結果についての意識を高めるために、公共教育キャンペーンを通じて人々がAIの潜在的な利点と落とし穴の両方を理解することを促進すべきです。

3. 倫理的なAI開発の促進: 人権とプライバシーを優先するバランスの取れたアルゴリズムを作成するために、多様な視点を取り入れた倫理的な成果に焦点を当てたAIの研究と開発を奨励します。

4. 透明性の促進: 組織は、透明性のあるAIシステムを開発し、AIコンテンツがどのように生成され、使用されるかについて明確な情報を提供すべきです。

プロとコントの概要

– プロ: AIの進展は、医療から映画制作までの業界で革新、効率性、能力の向上をもたらします。

– コント: AIの悪用の可能性は、プライバシー、安全性、倫理基準に対するリスクを提示し、緊急の注意と積極的な措置が必要です。

即時行動に向けた最終的な推奨事項

– 消費者の警戒: 個人は、自分が消費するAI生成コンテンツに注意を払い、その出所と真実性を疑問視すべきです。

– 規制のための提唱: 責任あるAI使用政策のために、地域および国際的な政策討論に参加します。

– 倫理的なAI慣行: AIを使用する企業は、倫理的ガイドラインに従い、自社のシステムが害や悪用に寄与しないようにする必要があります。

日本での出来事は、世界中の国々がAIガバナンスの複雑な課題にどのように取り組むかの新たな前例を設定する可能性があります。倫理的妥協のない継続的な革新のために、リンク名のような権威あるリソースを訪れて、さらなる洞察を得てください。