- Japonia aresztowała cztery osoby za sprzedaż generowanych przez AI obscenicznych obrazów, co stanowi pierwszy krok prawny kraju przeciwko takim działaniom.

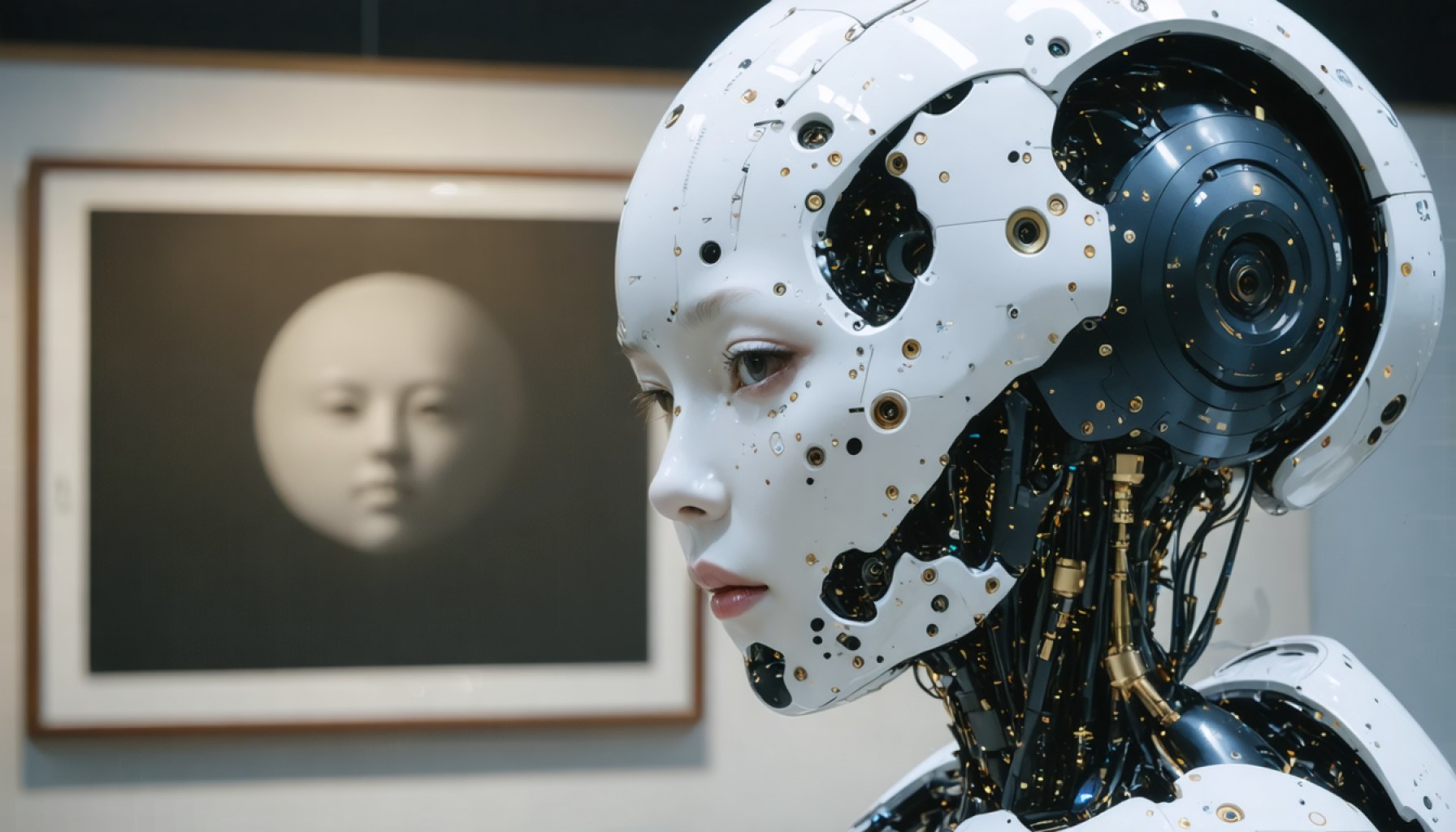

- Obrazy, przedstawiające nieistniejące kobiety, zostały stworzone przy użyciu generatywnej AI i sprzedane online jako plakaty.

- Sprawa ta podkreśla globalne obawy dotyczące nadużywania AI, szczególnie w kontekście treści deepfake, gdzie 96% filmów jest nielegalnych, często wymierzonych w kobiety.

- Generatywna AI może produkować hiperrealistyczne treści z prostych poleceń, co rodzi dylematy etyczne.

- Aresztowania podkreślają potrzebę globalnego dialogu i regulacji, aby zapewnić etyczne wykorzystanie AI przy jednoczesnej ochronie praw osobistych.

- Działania Japonii mogą potencjalnie ustanowić międzynarodowe precedensy, gdy świat szuka sposobów na zrównoważenie innowacji AI z kwestiami etycznymi.

W znaczącym rozwoju wydarzeń, japońskie władze podjęły zdecydowane działania, które podkreślają niepokojący skrzyżowanie między postępem technologicznym a moralnością. Cztery osoby, w różnym wieku od lat 20 do 50, stają teraz przed poważnymi oskarżeniami o sprzedaż obscenicznych obrazów stworzonych za pomocą generatywnej AI — co stanowi pierwszy prawny atak Japonii w tej kontrowersyjnej dziedzinie.

Osoby te rzekomo wykorzystały ogólnodostępne oprogramowanie AI do produkcji obrazów przedstawiających nieistniejące kobiety w kompromitujących i nieprzyzwoitych sytuacjach. Te cyfrowo wyczarowane obrazy były następnie sprzedawane jako plakaty na internetowych platformach aukcyjnych, osiągając ceny w zakresie kilku tysięcy jenów za sztukę. Ta intrygująca, ale niepokojąca drama rozgrywa się wśród rosnących globalnych obaw dotyczących potencjalnego nadużywania AI.

W złożonym świecie sztucznej inteligencji, algorytmy generatywne mają zdumiewającą zdolność do produkcji hiperrealistycznych obrazów i filmów z prostych poleceń tekstowych. Tak rewolucyjnie to brzmi, ta zdolność rodzi równie znaczące wyzwania. Niepokojące ujawnienie holenderskiego nadzorcy AI, Sensity, wskazuje, że oszałamiające 96 procent filmów deepfake krążących w sieci stanowi nielegalną pornografię, z kobietami jako głównymi ofiarami.

Ostatnie aresztowania w Japonii podkreślają pilną potrzebę globalnego dyskursu i regulacji dotyczących etycznych granic technologii AI. W miarę jak AI coraz bardziej integruje się z codziennym życiem, wykorzystanie jej obietnicy bez wpadania w pułapki wykorzystywania stanowi ogromne wyzwanie. Potrzebne są rozmowy na temat ochrony praw osobistych oraz ustanowienia etycznych wytycznych, które będą miały globalne odzwierciedlenie, mając na celu zapobieganie przekształceniu AI w narzędzie krzywdy.

Kluczowym wnioskiem z tych zaskakujących wydarzeń jest jasny apel o równowagę — dążenie do odpowiedzialnego wykorzystywania niezwykłych możliwości AI przy jednoczesnej czujności wobec jej potencjału do nadużyć. W miarę jak możliwości technologii się rozszerzają, również ramy, które nią rządzą, muszą się rozwijać, zapewniając, że innowacje nie wyprzedzają publicznych i etycznych rozważań. Świat obserwuje, jak Japonia porusza się po tym bezprecedensowym terytorium, ustanawiając potencjalne precedensy dla innych do naśladowania.

Wewnątrz japońskiego zaostrzenia działań przeciwko AI: Walka między innowacją a etyką

Rozpakowywanie pionierskiego działania Japonii przeciwko treściom generowanym przez AI

Ostatnie prawne zaostrzenie działań w Japonii przeciwko sprzedaży generowanych przez AI obscenicznych obrazów stanowi istotny moment w trwającej debacie na temat etycznego wykorzystania sztucznej inteligencji. Te aresztowania podkreślają rosnący konflikt między szybkim rozwojem technologii AI a towarzyszącymi im kwestiami etycznymi. Tutaj zagłębiamy się w ten złożony problem, dostarczając kontekstu, potencjalnych implikacji i spostrzeżeń na temat szerszego wpływu AI na społeczeństwo.

Jak AI zmienia krajobraz tworzenia treści

1. Algorytmy generatywne: Technologia stojąca za tymi generowanymi przez AI obrazami opiera się na zaawansowanych algorytmach zdolnych do tworzenia hiperrealistycznych obrazów i filmów z tekstowych poleceń. Ta innowacja, choć przełomowa, rodzi poważne pytania moralne i etyczne w przypadku nadużyć.

2. Podwójny miecz AI: Zdolność AI do tworzenia realistycznych treści stwarza unikalny problem — podczas gdy może zrewolucjonizować sektory takie jak rozrywka i reklama, niesie również poważne konsekwencje, takie jak tworzenie pornografii deepfake, dezinformacji czy nieautoryzowanych impersonacji osób.

Globalny kontekst i obawy

– Powszechność deepfake’ów: Badanie przeprowadzone przez Sensity wskazuje, że 96% filmów deepfake to pornografia bez zgody, głównie skierowana przeciwko kobietom. Ta statystyka podkreśla pilną potrzebę kompleksowych międzynarodowych wytycznych dotyczących tego nadużycia.

– Obecne regulacje: Chociaż niektóre kraje rozpoczęły dyskusje na temat regulacji, brakuje spójnej globalnej polityki lub infrastruktury do monitorowania i zapobiegania nadużyciom AI. Ta rozbieżność pozostawia przestrzeń na wykorzystywanie i podkreśla potrzebę zjednoczonego podejścia do zarządzania AI.

Przykłady zastosowań w rzeczywistości i ryzyka

– Pozytywne zastosowania: Potencjał AI obejmuje poprawę diagnostyki medycznej, tworzenie atrakcyjnych treści edukacyjnych oraz rozwijanie spersonalizowanych doświadczeń klientów. Jednak bez odpowiedniego nadzoru ryzyko nadużyć pozostaje ogromne.

– Prognoza rynkowa: Oczekuje się, że rynek sztucznej inteligencji będzie rósł w szybkim tempie, co podkreśla natychmiastową potrzebę etycznych ram do kierowania jej wdrażaniem w różnych branżach.

Kroki w kierunku odpowiedzialnego wykorzystania AI

1. Ustanowienie jasnych regulacji: Rządy i globalne podmioty muszą współpracować, aby stworzyć solidne ramy regulacyjne, które zapobiegną nadużyciom AI, jednocześnie wspierając postęp technologiczny.

2. Świadomość publiczna i edukacja: Należy zwiększyć świadomość na temat konsekwencji nadużyć AI poprzez kampanie edukacyjne, zapewniając, że ludzie rozumieją zarówno potencjalne korzyści, jak i pułapki AI.

3. Promowanie etycznego rozwoju AI: Zachęcanie do badań i rozwoju AI skoncentrowanych na etycznych wynikach, włączając różnorodne perspektywy, aby tworzyć zrównoważone algorytmy, które priorytetowo traktują prawa człowieka i prywatność.

4. Zachęcanie do przejrzystości: Organizacje powinny rozwijać przejrzyste systemy AI i dostarczać jasne informacje na temat tego, jak generowane i wykorzystywane są treści AI.

Przegląd zalet i wad

– Zalety: Postępy AI przynoszą innowacje, efektywność i zwiększone możliwości w różnych branżach, od opieki zdrowotnej po filmowanie.

– Wady: Potencjał nadużyć AI stwarza ryzyko dla prywatności, bezpieczeństwa i standardów etycznych, co wymaga pilnej uwagi i proaktywnych działań.

Ostateczne zalecenia dotyczące pilnych działań

– Czujność konsumentów: Osoby powinny być czujne wobec treści generowanych przez AI, kwestionując źródło i autentyczność.

– Advocacy for Regulation: Angażuj się w lokalne i globalne dyskusje polityczne, aby opowiadać się za odpowiedzialnymi politykami użytkowania AI.

– Etyczne praktyki AI: Firmy korzystające z AI powinny przestrzegać etycznych wytycznych, zapewniając, że ich systemy nie przyczyniają się do krzywdy ani nadużyć.

Rozwój wydarzeń w Japonii może ustanowić nowy precedens dla tego, jak państwa na całym świecie będą zmagać się z złożonym wyzwaniem zarządzania AI, splatając technologiczną sprawność z etyczną integralnością. Aby kontynuować innowacje bez kompromisów etycznych, odwiedź autorytatywne źródła, takie jak link name po więcej informacji.